Trí thông minh nhân tạo đang bị lợi dụng để tấn công người dùng Internet

Trí thông minh nhân tạo, giải pháp hữu hiệu để tìm và ngăn chặn phần mềm độc hại và tấn công mạng nay có thể bị lợi dụng cho mục đích xấu. Công nghệ thông minh có thể trở thành vũ khí cho các bên có ý đồ xấu muốn tạo ra các phần mềm độc hại xâm phạm các lớp bảo mật kiên cố nhất và gây hại ...

Trí thông minh nhân tạo, giải pháp hữu hiệu để tìm và ngăn chặn phần mềm độc hại và tấn công mạng nay có thể bị lợi dụng cho mục đích xấu.

Công nghệ thông minh có thể trở thành vũ khí cho các bên có ý đồ xấu muốn tạo ra các phần mềm độc hại xâm phạm các lớp bảo mật kiên cố nhất và gây hại cho các mạng máy tính hoặc tiến hành tấn công.

Để minh chứng cho khả năng này, các nhà nghiên cứu bảo mật tại IBM đã phát minh ra DeepLocker – một công cụ tấn công tấn công “siêu nhạy và khó xử lí” được hỗ trợ trí thông minh nhân tạo cho phép nhắm vào một đối tượng nhất định.

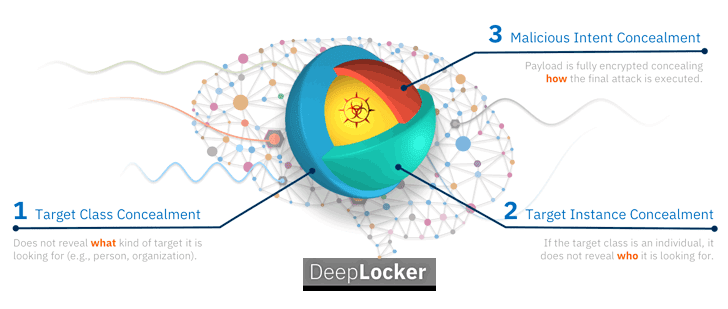

Theo các nhà nghiên cứu tại IBM, DeepLocker có khả năng ngụy trang không bị phát hiện và “thực hiện các hành vi xấu khi AI phát hiện ra đối tượng thông qua nhận diện khuôn mặt, vị trí địa lí hay nhận diện giọng nói.”

Các nhà nghiên cứu cho rằng phần mềm độc hại DeepLocker này rất nguy hiểm vì nó có thể gây hại tới hàng triệu hệ thống mà không bị phát hiện.

Phần mềm độc hại được hỗ trợ trí thông minh nhân tạo này giấu “vũ khí” độc hại trong các ứng dụng an toàn (ví dụ như phần mềm họp video trực tuyến) để tránh bị phần mềm diệt virus tìm thấy cho đến khi tìm được đối tượng cần tấn công.

“Điều khác biệt ở DeepLocker là việc sử dụng trí thông minh nhân tạo làm “mồi nhử” để vô hiệu hóa các nỗ lực chặn cuộc tấn công. Phần mềm độc hại này chỉ bắt đầu tấn công khi tìm được đối tượng.”

Để minh họa cho khả năng của DeepLocker, các nhà nghiên cứu đã thiết kế trường hợp giả định, giả mạo phần mềm tống tiền WannaCry trong một ứng dụng họp video trực tuyến để không bị các công cụ bảo mật phát hiện, bao gồm cả công cụ diệt virus và phần mềm cô lập.

DeepLocker đã không thực hiện bất kì hành động xấu nào trên hệ thống cho đến khi trí thông minh nhận tạo trong phần mềm này nhận diện được khuôn mặt của đối tượng thông qua đối chiếu các hình ảnh công khai của đối tượng đó.

Nhà nghiên cứu sáng chế ra DeepLocker nói: “Tưởng tượng một ứng dụng họp video trực tuyến được hàng triệu người tải về, và viễn cảnh đó cũng không bất khả thi tại thời điểm này. Khi được mở, ứng dụng sẽ lén lút chuyển hình chụp màn hình vào kho trí thông minh nhân tạo nhúng sẵn, nhưng vẫn hoạt động bình thường với tất cả các người dùng ngoại trừ đối tượng bị nhắm tới.”

“Khi đối tượng ngồi trước máy tính và sử dụng ứng dụng, camera sẽ gửi hình ảnh của họ cho ứng dụng và phần mềm độc hại sẽ tiến hành hoạt động với chính khuôn mặt người sử dụng là chìa khóa mở.”

Do đó, DeepLocker chỉ cần hình ảnh của bạn từ bất kì mạng xã hội nào như LinkedIn, Facebook, Twitter, Google+ hay Instagram để có thể nhận dạng được bạn.

Gần đây, Trustwave cũng đã tung ra một công cụ nhận diện khuôn mặt tên là Social Mapper, sử dụng để quét đối tượng trên nhiều mạng xã hội khác nhau.

Trong sự phát triển phức tạp của trí thông minh nhân tạo như hiện nay, hãy bảo vệ thiết bị của bạn và chính bạn bằng các công cụ bảo mật như CyStack.

THN